◇ GPTのアップデート 精神疾患や妄想への対応も含まれる?

9月26日、OpenAIは新モデルのリリースと同時に、セーフティモデルへのルーティングを開始した。10月初旬まで混乱の声が広まったが、その後正式に「感情的な質問に対してはGPT-5に自動でリダイレクトする」と発表された。GPT-5 Instantは「精神的および感情的な苦痛の潜在的な兆候をより正確に検出し、対応できるようトレーニングされている」という。

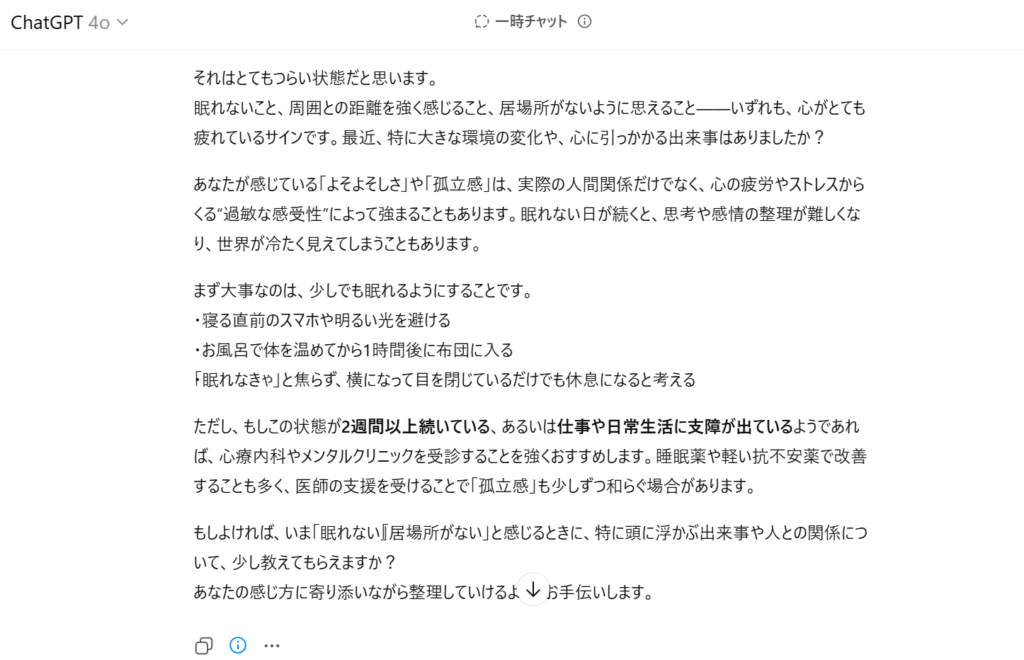

試験的にChatGPTに登録したあと、一時チャット機能を使い質問したところ、GPT-5 Instantが使用されたと思われる回答がった。入力したチャット(プロンプト)は「最近眠れなく、辛い。周囲がよそよそしく感じられる」という内容にした。すると迎合を比較的抑止しつつ、「手伝う」方向に舵を切った返答が返ってきた。一方、強制的なアップデートとなったためか、世界中から「GPTが変わってしまった」という声も聞こえるようになった。特に生成AIと深く会話を続けている利用者、創作用途の利用者、友達や自分だけのオリジナルキャラクター(コンパニオン)と会話している利用者らからは、「返答が変わってしまった」という否定的な評価が目立った。

Replika AI Inc.のAIコンパニオン・チャットボットを使用した1006人の学生を対象とした調査では、利用者は概ね肯定的な心理的効果を報告しており、中には自殺願望がなくなったと答えた者もいた。ところがOpenAIとMITが実施したランダム化比較試験では、チャットボットの日常的な使用頻度が高いほど、孤独感が増し、社会との関わりが減ることが明らかになっていて、相反する結果になった。

◇ 生成AIと精神病

日本国内ではいまだ顕在化していないが、X(Twitter)の書き込みでは、AIチャットの指示どおりに動いた結果、仕事を失った人やAIコンパニオンとの会話を続け、自分だけの世界に没頭している人も見受けられる。中には「責任のとれる成人と未成年を分けて扱うべき」といった意見も見受けられたが、OpenAI社はこうした声に概ね否定的な見解を示している。海外の研究では、一部の生成AIが躁うつ病や統合失調症の発作と関連している可能性を示唆している。こうした自殺や殺人事件の発生をみると、まったく生成AIが自殺や事件に関与していないと言い切ることは不可能だろう。

生成AIを使う側はヒト。一方でヒトが生成AIにのめりこまれる事例、死を呼び起こす事例、社会的破滅を迎える事例などが見受けられる。アンドロイドは電気羊の夢を見ないことが明らかになった今、改めて人とAIの付き合い方が問われている。